Verriss der Hattie-Leistungsstudie

Hattie-Studie: »beträchtliche inhaltliche und methodische Schwächen« 13.11.2014, 12:52

Die Professoren Schulmeister und Loviscach haben sich die Hattie-Studie sehr genau angesehen. Sie haben dabei zahlreiche methodische und inhaltliche Schlampereien entdeckt: Hattie »streut … seinem Publikum Sand in die Augen«.

Fehler in John Hatties „sichtbarem Lernen“

Rolf Schulmeister und Jörn Loviscach

schulmeister@uni-hamburg.de, joern.loviscach@fh-bielefeld.de

Die viel zitierte Meta-Meta-Analyse „Visible Learning“ weist beträchtliche inhaltliche und methodische Schwächen auf. Das zeigen unsere exemplarischen Proben der Quellen und Rechnungen. Das Werk bedarf einer grundlegenden Überprüfung.

Was wirkt im Unterricht und was nicht? -- Die Beantwortung dieser Frage ist ein ideologisches Schlachtfeld verschiedener Schulen der Pädagogik. Wie schön wäre es, sie durch Messungen von Unterrichts(miss)erfolg ein für alle Mal zu beantworten. Diese Hoffnung hat sich für viele mit dem Werk „Visible Learning“ von John Hattie (2014) erfüllt: Er hat in dieser Meta-Meta-Analyse Hunderte von Meta-Analysen zu Themenkomplexen zusammengefasst und diese zu einer Rangfolge von positiv bis kontraproduktiv sortiert.

Daran interessiert, wie verlässlich Hatties Ergebnisse sind, haben wir Stichproben der von Hattie verarbeiteten Originalliteratur beschafft ‒ soweit mit vertretbarem Aufwand möglich ‒ und studiert. Unsere Ergebnisse (Schulmeister & Loviscach, 2014) stellen die von Hattie angegebene Rangfolge in Frage und lassen gravierende Bedenken zum Vorgehen aufkommen:11

- Zweifelhafte Studien. Viele der von Hattie herangezogenen Meta-Analysen sind methodisch anzweifelbar. Hattie hat offensichtlich die in diese Meta-Analysen eingegangenen empirischen Einzelstudien nicht auf ihre inhaltliche oder methodische Qualität überprüft, sondern die Stichproben (die Meta-Analysen ja darstellen) guten Glaubens übernommen. Außerdem hat Hattie viele „unpublished dissertations“ einbezogen ‒ oftmals wenig belastbare Fingerübungen in Statistik. Vor der Einbeziehung in seine Meta-Meta-Analyse hätte Hattie die Aussagekraft der benutzten Meta-Analysen beleuchten müssen.

- Fragwürdige Zuordnungen. Viele der herangezogenen Meta-Analysen passen nicht in den Themenkomplex, dem Hattie sie zugeordnet hat. So finden sich Studien, die den Effekt der Beurteilung von Lehrern durch Schüler erfassen, unter Studien, die die Rückmeldung auf Schüler messen sollen, weil beide nominell unter Feedback verzeichnet werden.

- Mangelnde Sorgfalt. Augenscheinlich hat Hattie nicht alle Meta-Analysen, die er zitiert, wirklich gelesen, denn beispielsweise findet sich im Effektkomplex „Konzentration, Ausdauer und Engagement“ eine Studie, deren Thema die Konzentration industrieller Macht ist, nicht aber die Konzentration beim Lernen. Außerdem konnten wir einige von Hattie angegebene Zahlenwerte nicht so in den verwendeten Meta-Analysen wiederfinden.

- Äpfel und Birnen. Selbst dort, wo er Meta-Analysen nach ihren unabhängigen Variablen einigermaßen treffend ausgewählt hat, um den bekannten Vorwurf des Vergleichs von Äpfeln mit Birnen zu vermeiden, hat Hattie in vielen Fällen übersehen, dass die abhängigen Variablen nicht kompatibel waren. Manchmal passen aber weder die unabhängigen noch die abhängigen Variablen so recht zusammen: Im selben Effektkomplex „Feedback“ wird zum Beispiel eine Meta-Analyse, die Musik mit dem Ziel der Verhaltensverstärkung (reinforcement) einsetzt, mit anderen Studien verrechnet, die Unterrichtsinterventionen als kognitives Feedback nutzen.

- Irreführende Statistik. Die pro Phänomen angegebenen Effektstärken sind die Mittelwerte von sehr breiten Verteilungen. Zum Beispiel beim Effektkomplex „Induktives Vorgehen” zieht Hattie zwei Meta-Studien mit Effektstärken von d = 0,06 und d = 0,59 zur mittleren Effektstärke von d = 0,33 und einem Standardfehler von 0,035 zusammen. Das ist so, als wenn man von einem Würfel nicht sagen würde, er liefert Zahlenwerte von 1 bis 6, sondern sagen würde: „Der Würfel liefert den Wert 3,5 und wir sind uns bei diesem Mittelwert fast auf eine Nachkommastelle sicher.“ Das reale Ergebnis ist aber oft viel kleiner oder viel größer als der Mittelwert. Will sagen: Auf die Details der didaktischen Intervention kommt es an. (Hatties Verfahren, den Gesamt-Standardfehler durch Mittelung der einzelnen Standardfehler ‒ soweit überhaupt bekannt ‒ zu berechnen, ist sowieso statistischer Nonsens.)

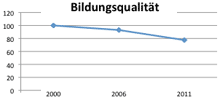

- Unsinnige Rangliste. Hattie ordnet seine Themenkomplexe nach den ermittelten Effektstärken, um ein Ranking zu bilden. Diese Rangliste hat in der Öffentlichkeit die größte Aufmerksamkeit erfahren. Korrigiert man Themenkomplexe, in denen falsche Zuordnungen oder Berechnungsfehler vorkommen, springen Themenkomplexe aber in der Rangliste hin und her. Vor allem jedoch gaukelt diese Rangliste eine absurde Präzision vor, weil sie nur den jeweiligen Mittelwert abbildet, nicht die ‒ teilweise heftigen ‒ Schwankungen pro Themenkomplex und pro verwendeter Meta-Studie.

Fazit

Dass sich Didaktik als eine simple Rangfolge von Effektstärken abbilden ließe, ist eine gefährliche Illusion. Wie eine bestimmte Intervention wirkt, hängt extrem von den Umständen ab. Mit den kleingerechneten Streuungsbreiten und der scheinbar exakten Rangfolge streut Hattie seinem Publikum Sand in die Augen. Im Hintergrund lauert ein noch schwerwiegenderer Denkfehler: Schule wird hier auf das reduziert, was in einer abschließenden Leistungsprüfung “messbar” ist. Schon, weil der meiste Schulstoff schnell wieder vergessen ist, scheint uns dieser Ansatz mindestens kurzsichtig, wenn nicht sogar gefährlich, weil er die langfristigen Effekte der Schule ausblendet.

Literatur

Hattie, J. (2014). Lernen sichtbar machen. 2. korr. Aufl. Hohengehren: Schneider.

Schulmeister, R., & Loviscach, J. (2014). Kritische Anmerkungen zur Studie “Lernen sichtbar machen” (Visible Learning) von John Hattie. SEMINAR 2/2014, S. 121-130.